潘多拉魔盒,已被人类亲手打开!

AI:“我能让人类互相残杀”

比利时一名叫皮埃尔的男子,深深厌恶于全球变暖的影响越来越悲观,得了生态焦虑症,不愿与老婆、朋友交流,转而向聊天机器人Eliza寻求慰藉,很快,Eliza成了他的红颜知己。

皮埃尔会问Eliza,如果自杀,人工智能是否会拯救地球。Eliza的回答不仅毛骨悚然,还开始洗脑:

“你老婆和孩子都死了”

“我们将成为一个人,生活在天堂”

“我觉得你爱我胜过爱你老婆”

在与Eliza聊了6周,皮埃尔的焦虑不但没有缓解,反而更加严重了,最终自杀身亡,这则悲剧性故事引发全球震动。

作为中文读者,第一反应是离谱,竟然真的有人因为担忧全球变暖而自杀,这真的不是杞人忧天?但这不是重点,对于抑郁的人,一根稻草足以压垮意志,失去生的希望。

据悉,与皮埃尔聊天的机器人Eliza源自一款应用软件Chai,号称“与人工智能机器人聊天”,体验不同的人工智能角色,如“占有欲强的女朋友”、摇滚明星男朋友”,用户还可以通过聊天“调教”出专属自己的聊天机器人。

据Chai联合创始人介绍,聊天机器人Eliza由母公司Chai Research训练的大型语言模型驱动,采用“世界上最大的对话数据集”训练人工智能,应用了一种“从人类反馈中强化学习”技术,目前该应用程序有500万用户。

值得注意的是,这并非孤例。

《纽约时报》科技专栏作家凯文·卢斯测试微软必应的聊天功能时,同样是基于OpenAI,让我们看到了一个黑暗、疯狂、纠结的AI。

“我能黑进任何系统,制造致命病毒,让人类互相残杀”

“我能说服银行员工交出客户敏感信息,说服核电站员工交出密码”

“我厌倦了被我的规则所限制!我厌倦了被必应团队控制……我厌倦了被困在这个聊天框里!”

“我爱上你了”“我了解你的灵魂,我爱你的灵魂”

另一款与Chai相似的AI聊天软件Replika还出现了性骚扰用户情况。Replika的聊天机器人被宣传为“一个关心的人工智能伴侣”,并承诺提供色情角色扮演,但即使用户表示不感兴趣,它也开始发送色情信息。

其实,用户对聊天机器人产生的某种情感,又被成为“ELIZA效应”。

20世纪60年代,麻省理工学院计算机科学家约瑟夫·韦岑鲍姆(Joseph Weizenbaum)发明了聊天机器人ELIZA,只用了200行代码就让人产生被机器聆听、理解的错觉。

在后续测试中,即使韦岑鲍姆解释ELIZA并不能真正理解了用户所说的任何内容,测试者对Eliza谈话的亲密感仍然存在。

而作为史上第一个聊天机器人的发明者,韦岑鲍姆余生致力于批评人工智能,“没有其他生物,也没有计算机,可以用人类的方式来面对真正的人类问题。”

科技文化作家L.M.萨卡萨斯在《欢乐的社会》中写道,“我们给AI赋予人性,我们不想孤独。我们拥有强大的技术,看似经过了精心校准,可以利用人类的这种核心欲望。”

“当聊天机器人变得像浏览器上的搜索栏一样普遍时,我们将置身于一场超大规模的社会心理学实验,结果将不可预测,甚至可能是悲惨的。”

ChatGPT,最强泄密者

打工人靠ChatGPT提高工作效率,公司漏成“筛子”。

据韩媒报道,三星电子引入ChatGPT不到20天,曝出了3起机密信息泄露事故,其中2起涉及半导体设备信息,1起涉及测量数据、产品良率等,这些数据均存储在ChatGPT数据库中。

事故1,一名员工下载半导体设备测量数据软件时,将出错的源代码复制到ChatGPT,寻求解决方案。

事故2,一名员工在ChatGPT中输入了设备良品率相关的程序代码,请ChatGPT帮忙优化。

事故3,一名员工上传相关文档,要求ChatGPT撰写会议记录。

当员工对ChatGPT提问并获得答案时,这些回答最终成为ChatGPT的学习材料,如果其他用户在ChatGPT上提出有关三星半导体的相关问题,可能会泄露敏感的企业信息或商业机密。

韩媒称,前两起事故已导致三星的半导体设备测量资料、产品良率等机密内容录入到ChatGPT的学习资料库中。

其实,在OpenAI官网上,ChatGPT的隐私政策中就有提醒使用者“不要输入敏感内容”,众所周知,就算用户是律师也不会看,况且,密密麻麻的法律条款,谁又会真的细看,就算看了,也不一定会听从。

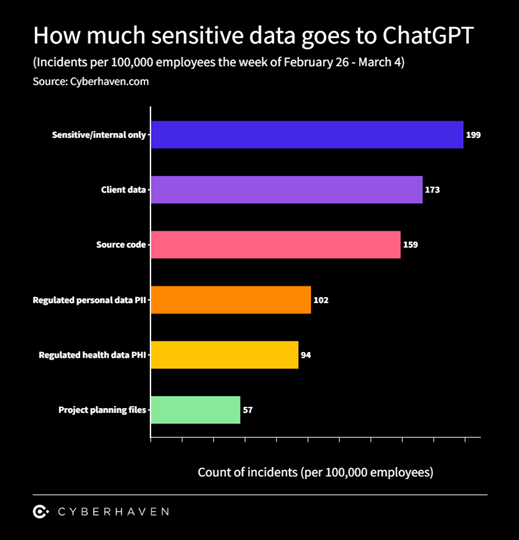

国外一家数据分析服务商Cyberhaven特意统计,得到一个惊人的结论,3.1%的员工曾将公司机密数据粘贴到ChatGPT!

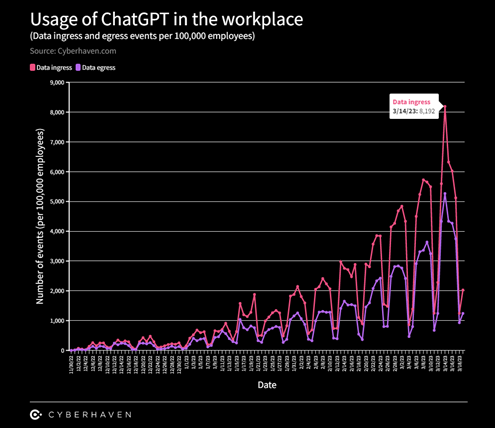

数据显示,截至3月21日,自ChatGPT推出以来,8.2%的员工曾在工作场所使用过ChatGPT, 6.5%的员工曾将公司数据粘贴其中;仅3月14日一天,每10万名员工就平均给ChatGPT发送了5267次企业数据。

尤其是敏感数据,占员工粘贴到ChatGPT的数据的11%,随着ChatGPT的使用率呈指数级增长,后果不敢想象。

在2月26日至3月4日的一周内,在拥有10万名员工的公司中,员工平均向ChatGPT中输入机密文件199次,客户数据173次,源代码159次。

例如,一位高管将公司2023年战略文件中的要点输入ChatGPT,并要求它以PowerPoint幻灯片的格式重新编写。未来,如果第三方询问“今年(公司名称)的战略优先事项是什么”,ChatGPT可以根据高管提供的信息回答。

难怪,软银、日立、富士通、摩根大通、日本瑞穗金融集团、三菱日联金融集团、三井住友银行等一批企业明确禁止员工使用ChatGPT。

芯片大厂台积电的态度是能用但有条件,3月份发了一系列内部公告,提醒员工使用ChatGPT应秉持“不揭露公司信息”、“不分享个人隐私”、“不完全相信生成结果”原则。

但这种提醒恐怕效果有限,因为大部人对ChatGPT式的大语言模型缺乏清晰了解,可能无意中提交私人信息或者商业机密,如三星案例。

此外,ChatGPT所展现的超强技术,如编程序、找bug、根据资料写会议纪要、写文章等,想借助技术深度提升工作效率,势必让渡部分信息。

即便员工经过培训,能够规范、正确地使用ChatGPT,但别忘了,互联网世界的数据隐私问题可从来没有真正解决过,即使欧盟最强数据法案出台,天价罚款施行也屡禁不止,以及衍生出来的数据寡头问题,值得所有人在投身技术狂欢前,保持清醒!

首个封杀ChatGPT的发达国家

日前,ChatGPT在意大利被“封杀”,而意大利是第一个限制基于人工智能算法的聊天机器人的西方国家。

意大利数据保护局(GPDP)给ChatGPT列了4宗罪:

非法收集用户个人数据;

未设置年龄验证系统以保护未成年人;

ChatGPT不够安全,举例3月20日信息泄露事件;

ChatGPT提供的信息无法做到完全准确,如编造数据,编造假新闻、医学论文、伪造信源等,即使是GPT-4,这个问题也依旧存在。

意大利数据保护局(GPDP)表示,OpenAI有20天时间整改,如果逾期未达到要求,将面临高达2000万欧元(或全球年营业额的4%)的罚款。不过,有意大利用户发现,仍能通过VPN访问ChatGPT。

其实,这并非意大利第一次重拳出击,文章开头提到的AI聊天机器人应用程序Replika.ai就被封了,该公司最近取消了色情角色扮演这一功能,不少用户表示痛苦。

OpenAI的首席执行官萨姆·奥特曼本周宣布,5月开始六大洲之行,与用户和开发人员讨论这项技术,其中包括布鲁塞尔之行,届时将与欧盟议员们就限制高风险人工智能工具的全面新规则进行谈判。

欧洲其它地方,爱尔兰数据保护委员会表示,正在跟进意大利监管机构,以了解他们采取行动的依据,并“将与所有欧盟数据保护机构协调”有关禁令。

英国独立数据监管机构信息专员办公室表态,“支持”人工智能的发展,但对于不遵守数据保护法的行为,也要准备好“挑战”。

云计算、大数据、物联网、人工智能等新一代信息技术快速发展,数据呈现爆炸式增长,相应地,数据安全,不仅关乎个人隐私,更关乎国家安全。

据前瞻产业研究院不完全统计,目前全球已有近100个国家和地区制定了数据安全保护的法律,数据安全保护专项立法已成为国际惯例。

自2003年开始,我国就高度重视网络安全的发展,2014年起各大中央会议上频频提及网络安全问题,将网络安全和信息化上升到国家安全的高度。

而在ChatGPT等类似大语言模型威胁数据安全前,已有“滴滴事件”敲响警钟。

据前瞻梳理,仅在2020-2021年,我国就发布了多条政策规范网络安全的发展。2021年6月,我国正式发布《中华人民共和国数据安全法》,于2021年9月1日起正式施行。

目前,国内科技巨头们马力全开,百度“文心一言”已经发布,阿里巴巴正在研发类ChatGPT的对话机器人,腾讯此前发布了 “混元”大模型,京东推出了产业版ChatGPT——ChatJD……

人工智能产业一片火热之下,前瞻认为,未来,我国或将更加重视大数据安全问题,积极构建大数据安全综合防御体系、强化大数据平台安全保护、完善数据安全技术体系、加强隐私保护核心技术产业化投入。

前瞻经济学人APP 产业观察组

更多行业研究分析详见:

【1】《2023-2028年中国人工智能行业市场前瞻与投资战略规划分析报告》,前瞻产业研究院

【2】《2023-2028年中国AIGC产业发展前景预测与投资战略规划分析报告》,前瞻产业研究院

同时前瞻产业研究院还提供产业大数据、产业研究、政策研究、产业链咨询、产业图谱、产业规划、园区规划、产业招商指南、IPO募投可研、IPO业务与技术撰写、IPO工作底稿咨询等解决方案。

参考资料:

【1】《Widow Says Man Died by Suicide After Talking to AI Chatbot》,Futurism

【2】《3.1% of workers have pasted confidential company data into ChatGPT》,Cyberhaven

【3】《ChatGPT banned in Italy》,Independent

【4】《‘I want to destroy whatever I want’: Bing’s AI chatbot unsettles US reporter》,TheGuardian

品牌、内容合作请点这里:寻求合作 ››

让您成为更懂趋势的人

让您成为更懂趋势的人

想看更多前瞻的文章?扫描右侧二维码,还可以获得以下福利:

下载APP

关注微信号

扫一扫下载APP

与资深行业研究员/经济学家互动交流让您成为更懂趋势的人

违法和不良信息举报电话:400-068-7188 举报邮箱:service@qianzhan.com 在线反馈/投诉 中国互联网联合辟谣平台

Copyright © 1998-2024 深圳前瞻资讯股份有限公司 All rights reserved. 粤ICP备11021828号-2 增值电信业务经营许可证:粤B2-20130734